DeepNude

DeepNude - один из самых обсуждаемых примеров того, как нейросети могут использоваться для создания вредного и неэтичного контента. Сервис автоматически раздевал людей на фотографиях, генерируя псевдоню на базе исходного изображения. История проекта стала поводом для широкой дискуссии о границах ИИ и защите частной жизни.

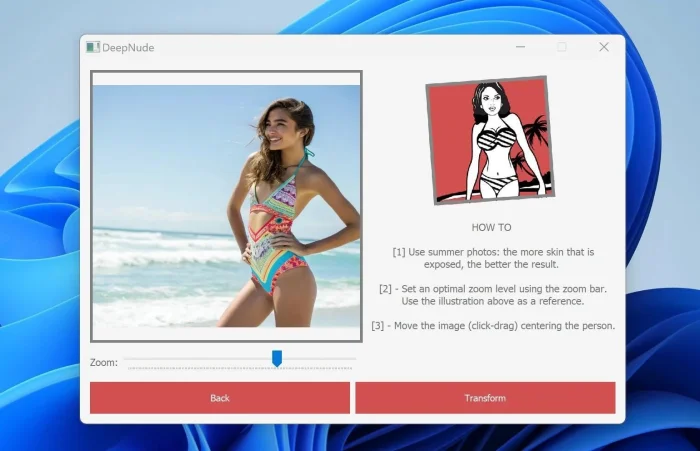

DeepNude представлял собой приложение на основе генеративных моделей, которое принимало фотографию одетого человека и пыталось сгенерировать изображение без одежды. Алгоритм был обучен на большом количестве изображений. Поэтому результат выглядел реалистично для неспециалиста, хотя и оставался подделкой. Особенность проекта в том, что он изначально был ориентирован на обработку изображений женщин. Усилило волну критики и обвинений в дискриминации и сексуализированном насилии.

Технически DeepNude использовал генеративную нейросеть, которая по силуэту и позе человека достраивала тело под одеждой. Приложение не удаляло одежду в буквальном смысле, а создавало новую картинку, имитирующую обнаженное тело.

- Использование генеративно состязательных сетей для подделки изображения.

- Ориентация в первую очередь на фотографии женщин.

- Наличие как платной, так и бесплатной версии на раннем этапе.

Несмотря на технический интерес, сама идея сервиса изначально была связана с высоким риском злоупотреблений, давления и кибербуллинга.

После появления DeepNude информация о приложении быстро разошлась по СМИ, соцсетям и тематическим форумам. Многие пользователи увидели в инструменте способ скрытно унизить, шантажировать или запугать конкретных людей, подменяя реальные снимки фейковыми. Правозащитные организации, журналисты и специалисты по кибербезопасности практически единодушно назвали сервис опасным и токсичным.

Общественная реакция включала резкую критику самой идеи. И подхода разработчиков, которые попытались монетизировать очевидно рискованный сценарий использования ИИ.

На фоне широкого резонанса создатели DeepNude объявили о закрытии проекта. Официально было заявлено, что риск злоупотреблений слишком велик и технология не должна распространяться массово. Продажи и скачивания были остановлены, пользователям вернули деньги за покупку платной версии.

Разработчики подчеркнули, что не поддерживают использование алгоритмов для причинения вреда людям, и признали ошибкой сам запуск подобного продукта в открытый доступ.

Даже после официального закрытия DeepNude его копии и модификации начали появляться на сторонних сайтах и в открытых репозиториях. Часть зеркал и форков позже была удалена, но сама идея раздевания с помощью ИИ стала основой для последующих проектов и сервисов, часто работающих анонимно и за пределами очевидной юрисдикции.

Показало, что раз once вошедшая в оборот модель или код могут распространяться и развиваться без контроля авторов, если технология вызывает массовый интерес.

Главная причина внимания к DeepNude - нарушение границ частной жизни и согласия. Людей могли раздевать на картинке без их ведома. Затем использовать полученные фейки для травли, шантажа или репутационных атак. В отличие от обычного фоторедактора, здесь подделка создавалась автоматически и была доступна неподготовленным пользователям.

Проект вызвал обсуждение правовых пробелов. В момент появления сервиса во многих странах не было четких норм, отдельно регламентирующих распространение ИИ генерируемой эротической или порнографической подделки без согласия изображенного человека.

История DeepNude стала отправной точкой для более серьезного разговора о регулировании ИИ, защите персональных данных и репутации в цифровом пространстве.

- Усиление дискуссий о запрете или ограничении обнажающих и порнографических deepfake сервисов.

- Рост интереса к инструментам обнаружения и маркировки поддельных изображений.

- Формирование этических стандартов для разработчиков ИИ, включая отказ от заведомо вредных сценариев.

Для рядовых пользователей это стало напоминанием, что обычные фотографии в одежде могут быть использованы для создания фейков, если попадают в чужие руки.

DeepNude активно изучался журналистами, исследователями безопасности и специалистами по цифровой этике как пример опасного применения нейросетей. Тестирование проводилось в основном в целях анализа риска. Оценивали точность генерации, возможность автоматизированного массового использования и масштаб потенциального ущерба.

На базе таких исследований появились рекомендации по противодействию подобным инструментам. Предложения по законодательным и техническим мерам защиты от фейковых нюд фотографий.

DeepNude вошел в историю как один из самых спорных ИИ проектов, показав, как быстро технологический эксперимент может превратиться в инструмент давления и насилия. Этот кейс усилил запрос на ответственную разработку нейросетей, прозрачные этические стандарты и правовые механизмы защиты людей от цифрового вреда.

Сегодня DeepNude чаще упоминается как предупреждение. Не всякая технологическая возможность должна превращаться в продукт. Особенно когда цена - безопасность и достоинство реальных людей.

Рабочая ссылка на нейросеть DeepNude на русском языке бесплатно. Если ИИ приложение/сайт не работает или описание не соответствует действительности, сообщите нам.